Blog

Autonomiczny dylemat: Dlaczego robotaksówki Waymo mają problem z autobusami szkolnymi?

Ostatnie miesiące przyniosły niezwykle istotne wydarzenia dla sektora transportu autonomicznego, które pokazują, że nawet najbardziej zaawansowane systemy mierzą się z wyzwaniami w starciu z przepisami ruchu drogowego. Amerykańska Krajowa Administracja Bezpieczeństwa Ruchu Drogowego (ang. National Highway Traffic Safety Administration – NHTSA) rozpoczęła oficjalne dochodzenie o numerze PE25013, dotyczące floty około 2000 autonomicznych pojazdów Waymo wyposażonych w system ADS 5. generacji. Bezpośrednim impulsem do wszczęcia procedury w październiku 2025 roku był raport medialny o incydencie w Atlancie, gdzie robotaksówka omijała stojący autobus szkolny. Zgodnie z dokumentacją Biura ds. Badania Wad (ang. Office of Defects Investigation – ODI), pojazd Waymo, wyjeżdżając z prostopadłej ulicy, nie zatrzymał się, lecz ominął autobus, przejeżdżając obok wysuniętego ramienia bezpieczeństwa i świateł ostrzegawczych w momencie, gdy uczniowie opuszczali pojazd [NHTSA ODI Resume, PE25013]. To zdarzenie, choć nie zakończyło się obrażeniami, stało się symbolem technicznych trudności, z jakimi boryka się sztuczna inteligencja w sytuacjach wymagających pełnego zrozumienia kontekstu społecznego i prawnego.

Problem okazał się mieć charakter systemowy, co potwierdzają dane z innych lokalizacji. W Austin, w stanie Teksas, tamtejszy okręg szkolny (Austin Independent School District) poinformował o dziewiętnastu przypadkach niezgodnego z przepisami i niebezpiecznego omijania autobusów przez pojazdy Waymo od początku roku szkolnego 2025-26. Statystyki te są alarmujące – wyliczono, że autonomiczne auta dopuszczają się średnio 1,5 naruszenia przepisów tygodniowo, co wywołało falę niepokoju wśród rodziców i władz lokalnych. W efekcie, do śledztwa prowadzonego przez NHTSA dołączyła Krajowa Rada Bezpieczeństwa Transportu (ang. National Transportation Safety Board – NTSB), tworząc dwutorowy front kontroli federalnej. Eksperci zauważają, że sytuacja ta jest klasycznym przykładem „edge case” – scenariusza brzegowego, który mimo przejechania przez flotę Waymo ponad 100 milionów mil do lipca 2025 roku, nadal pozostaje trudny do poprawnej interpretacji przez algorytmy [Artykuł prasowy, I. Garcia, 26.01.2026].

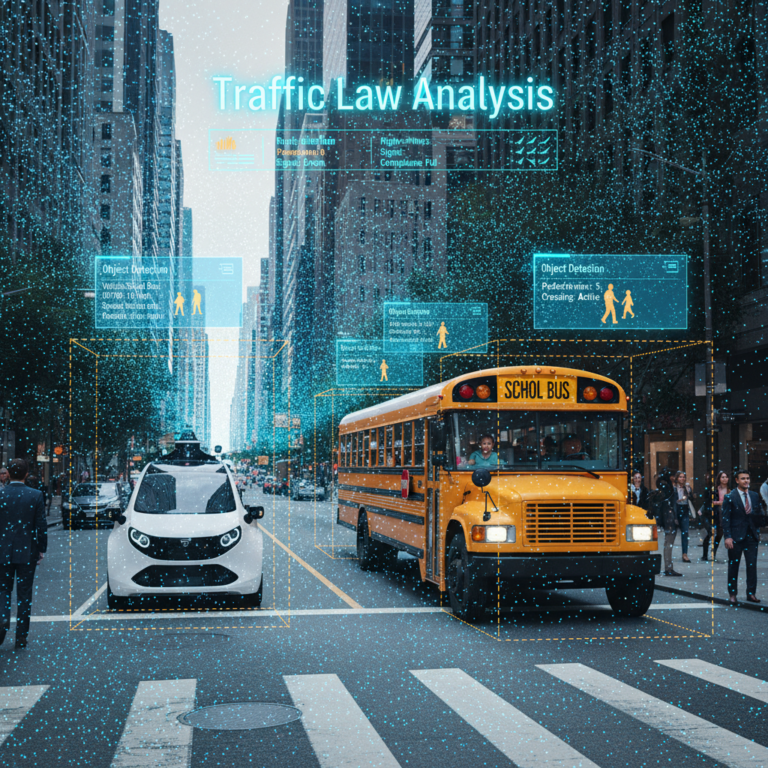

Z punktu widzenia technologii pojazdów połączonych, kluczowym problemem jest dystans między percepcją a rozumowaniem. Chociaż lidar, radar i kamery poprawnie wykrywają autobus, systemy decyzyjne mają problem z dopasowaniem tego obrazu do konkretnych przepisów ruchu drogowego, które mogą różnić się w zależności od stanu. Mamy tu do czynienia z systemem, który „widzi”, ale nie zawsze „rozumie” powagę sytuacji, co uwidoczniło luki w dotychczasowych modelach testowania i symulacji. Waymo argumentowało, że w przypadku incydentu w Atlancie pojazd zbliżył się pod takim kątem, że światła ostrzegawcze i znak „stop” nie były widoczne dla czujników. Mimo tych wyjaśnień, firma zdecydowała się na przeprowadzenie akcji naprawczej (recall) w grudniu 2025 roku, wprowadzając aktualizacje oprogramowania mające na celu poprawę interakcji z transportem szkolnym [NTSB/Waymo updates, 2025-2026].

Przyszłość branży zależy teraz od zdolności do wdrożenia tzw. wyjaśnialnej sztucznej inteligencji (ang. Explainable AI) oraz hybrydowych architektur, które nałożą sztywne, nienegocjowalne reguły prawne na elastyczne modele uczenia maszynowego. Dla inwestorów i operatorów, takich jak Alphabet (właściciel Waymo), obecne dochodzenia oznaczają wzrost kosztów operacyjnych i ryzyko ubezpieczeniowe, co może spowolnić planowaną ekspansję do miast takich jak Tokio czy Londyn. Kluczowym wnioskiem z obecnego kryzysu jest fakt, że zaufanie społeczne do pojazdów autonomicznych nie buduje się jedynie na statystykach bezwypadkowości, ale przede wszystkim na bezwzględnym przestrzeganiu zasad bezpieczeństwa w najbardziej wrażliwych punktach, takich jak strefy szkolne i przystanki autobusowe [Analiza: Shaping the Next Chapter, 2026]. Choć technologia ADS (ang. Automated Driving Systems) obiecuje eliminację ludzkich błędów, incydenty z Austin i Atlanty pokazują, że maszyny muszą najpierw „nauczyć się” pełnego respektowania norm, które dla „ludzkich” kierowców są oczywiste.

Źródła:

https://static.nhtsa.gov/odi/inv/2025/INOA-PE25013-23069.pdf

https://www.theverge.com/news/838879/waymo-school-buses-probe

https://biztechweekly.com/waymo-under-regulatory-scrutiny-for-failing-to-stop-at-school-buses-ntsb-and-nhtsa-investigate-multiple-incidents-in-austin-and-atlanta/

https://www.msn.com/en-us/autos/self-driving-cars/after-nhtsa-us-safety-board-opens-probe-into-waymo-behavior-around-school-buses/ar-AA1UT1bP